スクレイピングを試したいけれど、どこまでやってよいのか不安。

サンプルコードを貼る前に、規約やrobots.txtをどう見ればよいか分からない。

アクセス制限や403エラーが出た時に、原因を切り分けられるか心配。

なべくんです。

結論から言うと、スクレイピングはコードを書く前に、規約、robots.txt、アクセス間隔、取得データの扱いを確認するのが安全です。

ただし、便利そうに見える作業ほど、最初に確認しておくことがあります。APIキー、外部サービス、スクレイピング、WordPress連携、GASの権限まわりは、動くかどうかだけでなく「安全に続けられるか」まで見ておきましょう。

この記事では、安全にスクレイピングを始めたい 方に向けて、手元で試せる順番に整理します。

この記事で分かること

- スクレイピング前に見る場所

- robots.txtの基本

- アクセス負荷を下げる考え方

- 取得データの扱い方

先に注意点

| 注意点 | 理由 |

|---|---|

| 小さく1件だけ試す | まとめて動かすと、失敗した時に原因を切り分けにくいため |

| 認証情報をコードに直書きしない | 共有やGit管理で漏れると、外部から使われる可能性があるため |

| 公式情報を確認する | 画面、API、制限、料金、規約は変わる可能性があるため |

| ログと実行結果を残す | 後から同じエラーを見た時に、確認順を再利用できるため |

| 実務投入前に手動確認を挟む | 誤送信、誤投稿、過剰アクセスを避けるため |

コードを書く前に規約と目的を確認します

この見出しの結論: 取得してよい情報か、何のために使うかを先に決めます。

スクレイピングは、便利さだけで進めると危ないテーマです。特にログインが必要な情報、個人情報、購入履歴、会員限定情報などは慎重に扱う必要があります。まずは公開情報の範囲で、業務上の確認や学習に必要な最小限から始めましょう。

robots.txtはクロール方針の入口として見ます

この見出しの結論: robots.txtは万能な許可証ではなく、サイト側のクロール方針を確認する入口です。

robots.txtは、検索エンジンなどのクローラーに向けた制御ファイルです。Googleのドキュメントでも、robots.txtはクロール制御の仕組みとして説明されています。検索に出すかどうかの制御や、規約の代わりではありません。

アクセス間隔を空けて負荷を下げます

この見出しの結論: 短時間に大量アクセスせず、1件ずつ結果を確認する設計にします。

スクレイピングのサンプルではfor文で一気にURLを回すことがありますが、実務でそのまま使うのは危険です。まずは1URLだけ確認し、取得できること、保存できること、エラーが出たときに止められることを確認しましょう。

取得データの保存範囲を決めます

この見出しの結論: 取れるものを全部保存するのではなく、必要な項目だけに絞ります。

HTMLには本文以外にも、ID、トラッキング用の値、ユーザー情報に近いものが含まれる場合があります。実務で使うなら、保存する列を事前に決め、不要な情報を残さない方が安全です。

エラーは制限回避ではなく原因切り分けで見ます

この見出しの結論: 403や429は、回避策探しより先に、取得方法そのものを見直します。

403はアクセス拒否、429はリクエスト過多の可能性があります。ここで無理に回避しようとするのではなく、規約、アクセス頻度、APIの有無、手動確認で足りるかを見直しましょう。公式APIがあるサービスでは、API利用の方が安全な場合があります。

実務で使う前のチェックリスト

- 入力データに個人情報や機密情報が含まれていないか。

- 実行環境、ライブラリ、APIのバージョンをメモしたか。

- 1件だけテストして、成功時の出力を確認したか。

- エラー時に見る場所を決めたか。

- 外部サービスの規約、料金、アクセス制限を確認したか。

- 同じ処理を何度も実行しても事故にならないか。

よくある質問

robots.txtで許可されていれば何をしてもよいですか?

いいえ。robots.txtはクロール制御の目安であり、サイト規約や法律、アクセス負荷への配慮も別に確認する必要があります。

スクレイピングは違法ですか?

一律に違法とは言えませんが、規約違反、過剰アクセス、個人情報取得、ログイン突破などは問題になり得ます。

403や429が出たらどうすればよいですか?

制限回避を考える前に、アクセス頻度、User-Agent、認証要否、規約、取得対象を確認しましょう。

実務で使うなら何を記録すべきですか?

取得URL、取得日時、件数、HTTPステータス、エラー、利用目的を記録しておくと確認しやすくなります。

次に読む記事

参考URL

- Google Search Central SEO Starter Guide: https://developers.google.com/search/docs/fundamentals/seo-starter-guide

- Google Search Central helpful content: https://developers.google.com/search/docs/fundamentals/creating-helpful-content

- Google robots.txt intro: https://developers.google.com/search/docs/crawling-indexing/robots/intro

- Python urllib.robotparser: https://docs.python.org/3/library/urllib.robotparser.html

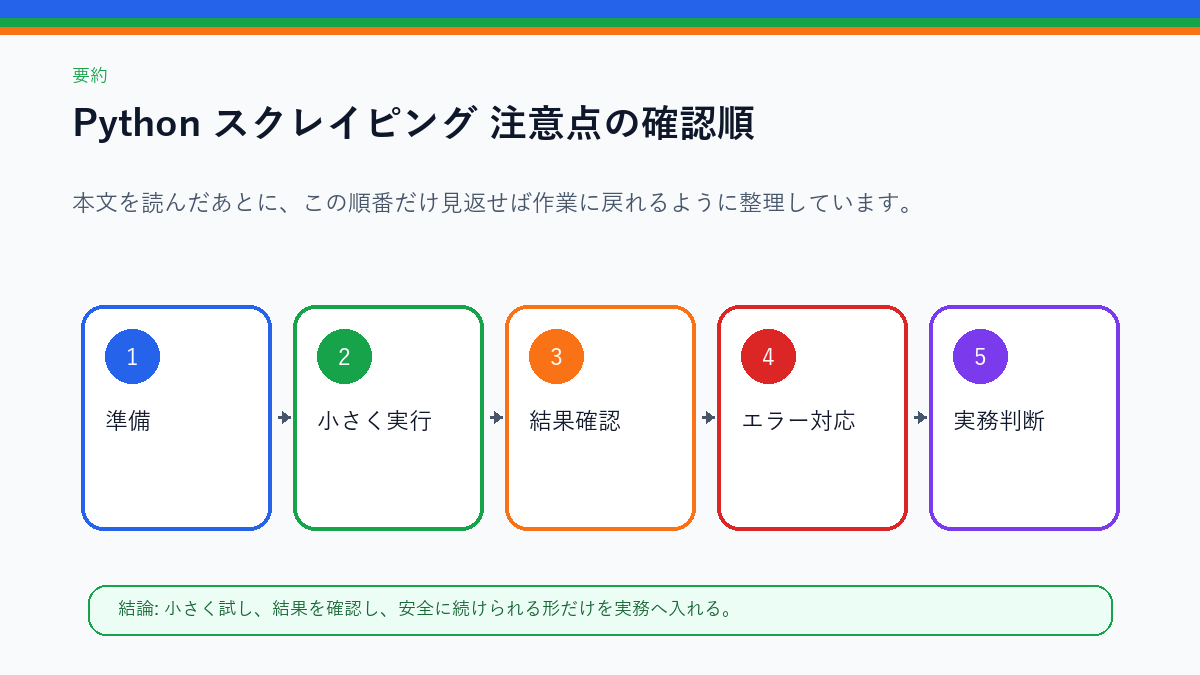

まとめ

Python スクレイピング 注意点 は、最初から完璧に理解しようとすると手が止まりやすいテーマです。まずは小さく動かし、成功時の出力とエラー時の見る場所を残しておくと、次の作業がかなり楽になります。

同じような課題に直面している方の助けになれば幸いです。